30.03.2026 - 22:00:01 <anon> ekanen

30.03.2026 - 22:02:45 <anon> Holy shit. That piece of crap calls itself a dev.

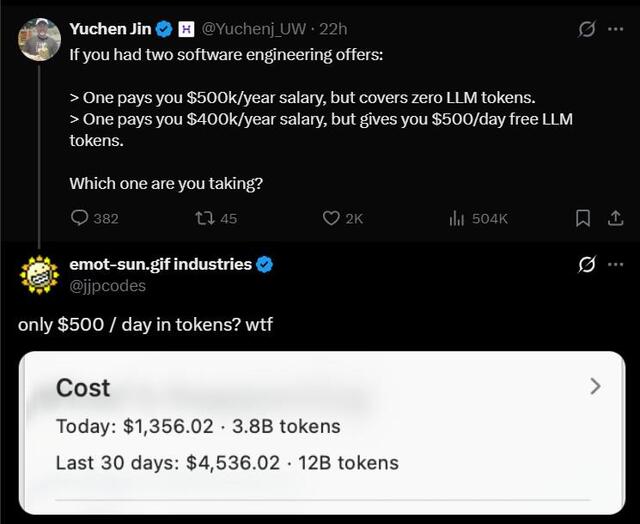

30.03.2026 - 22:47:27 <anon> $500k/y and then just not use chatbots

30.03.2026 - 22:49:49 <anon> mitä vittua tossa lukee?

30.03.2026 - 23:20:26 <anon> 30.03.2026 22:49:49 <anon> mitä vittua tossa lukee? <<< Että mua tulee hakemaan iskä

31.03.2026 - 00:02:38 <anon> That's one rough day but the average is 150 / day for the last month.

31.03.2026 - 00:44:12 <anon> ajakaa lokaaleina niin ei maksa tokenin tokenia. eikö riitä rauta? haha

31.03.2026 - 00:45:39 <anon> Teenköhän jotain väärin kun mulla kuluu vaan $30 edestä tokeneita kuussa?

31.03.2026 - 01:57:21 <anon> Ei kukaan järkevä kooderi tarvitse mitään LLM tokeneita. Osaamista siihen tarvitaan, eikä valehtelukonetta.

31.03.2026 - 03:20:06 <anon> it doesn't take AI to realize you won't get that much money either way...ass hat...fucking retard thinking he can vibe code, make great prompts to generate garbage like EVERY OTHER ASS HAT in the universe

31.03.2026 - 03:20:31 <anon> i can't wait for the end of the world so i can shoot this fucktard

31.03.2026 - 08:39:11 <anon> Resurssipula on se ettei haluta maksaa riittävälle määrälle henkilöstöä riittävästi palkkaa.

31.03.2026 - 09:24:12 <anon> Mikä on "LLM token"?

31.03.2026 - 10:08:21 <anon> 500k, easy

31.03.2026 - 10:38:50 <anon> take the 500k and retire after 1 year

31.03.2026 - 10:38:50 <anon> take the 500k and retire after 1 year

31.03.2026 - 10:38:51 <anon> take the 500k and retire after 1 year

31.03.2026 - 12:01:16 <anon> mongrels, both of them

31.03.2026 - 16:19:05 <anon> Olen putkimies enkä ymmärrä tästä hevonvittua.

01.04.2026 - 11:45:13 <anon> Mikä on "LLM token"? > AI jargonia, kaikki puhuu tokeneista ja loopista

01.04.2026 - 11:48:52 <anon> "When you work with a large language model (LLM), text is first broken into units called tokens, which are words, character sets, or combinations of words and punctuation, by a tokenizer."